Project Relight di Adobe: presentati alcuni nuovi strumenti AI al MAX di Los Angeles. Adobe ha già annunciato questa settimana tantissime nuove funzionalità per l’intera suite Creative Cloud, tra cui nuovi assistenti AI per Photoshop ed Express e modelli personalizzati per Adobe Firefly. Ma la parte più entusiasmante di qualsiasi conferenza Adobe MAX è Sneaks, dove l’azienda svela anticipazioni su tecnologie e idee future. Definito come “l’Oscar per gli ingegneri Adobe”, lo show ha offerto un posto in prima fila per scoprire cosa bolle in pentola in Adobe Research, tra cui alcune idee piuttosto innovative.

Project Relight: quali sono le novità AI di Adobe in arrivo?

Motion Map è in grado di aggiungere animazioni alle immagini statiche di Illustrator. Utilizzando semplici prompt di testo, gli utenti possono far muovere le immagini fisse e lo strumento può persino rilevare singoli livelli (nell’esempio che abbiamo visto sul palco, è stato in grado di separare diversi livelli di un hamburger e animarli sovrapponendoli).

Clean Take, uno strumento audio consente agli utenti di modificare l’audio nei video. Nella demo, abbiamo visto la possibilità di evidenziare le parole in una trascrizione e modificarne l’inflessione, o persino le parole stesse. Lo strumento consente inoltre agli utenti di suddividere l’audio di sottofondo in tracce separate e di regolarne il volume o persino di silenziarlo. Lo strumento può persino sostituire la musica di sottofondo con una versione simile (e royalty-free) generata dall’intelligenza artificiale.

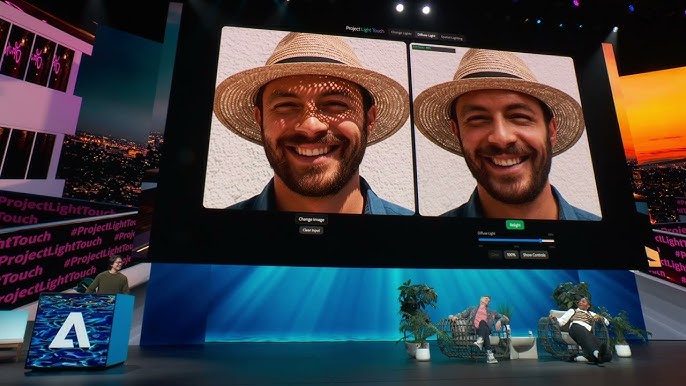

Tra i più grandi successi della serata c’è Light Touch, uno strumento che consente di regolare l’illuminazione di una fotografia in fase di post-produzione. Nelle demo abbiamo visto interni con lampade accese e spente, che modificavano completamente il profilo di illuminazione dell’immagine e facevano apparire o scomparire le ombre a comando.

Altri strumenti AI molto interessanti

Frame Forward: si tratta di un incredibile strumento consente agli utenti di modificare un intero video, modificando solo il primo fotogramma, ovvero modificando un’immagine. Gli utenti possono modificare il primo fotogramma in Photoshop , rimuovendo oggetti o aggiungendo elementi, e l’IA trasferirà queste modifiche all’intero video. Nella demo sul palco, abbiamo visto una donna su un paddleboard completamente rimossa da un video e una clip di un matrimonio in cui i personaggi sullo sfondo sono stati rimossi e l’illuminazione completamente modificata, semplicemente modificando quel primo fotogramma.

La configurazione è stata presentata mercoledì sera durante la conferenza annuale Max Creativity dell’azienda, un evento di più giorni a Los Angeles a cui hanno partecipato oltre 10.000 persone. La nuova offerta è stata presentata nell’ambito di Adobe Max Sneaks, che mette in risalto le innovazioni dei team di ricerca e ingegneria dell’azienda.

La componente Sneaks di Max è progettata per aiutare l’azienda a entrare in contatto con la comunità creativa e raccogliere feedback. Jessica Williams, ex inviata del Daily Show e membro del cast di Shrinking su Apple TV , ha presentato l’edizione di quest’anno di Sneaks.

Il nuovo Adobe Firefly

Adobe Firefly Image Model 5 è disponibile da oggi. Come Image Model 4, il modello aggiornato ha una risoluzione nativa di 4 megapixel, il che significa che può generare immagini in 2K (2560 x 1440). Supporta anche l’editing basato su prompt, che consente di generare modifiche a 2 MP o Full HD (1920 x 1080). Il grande miglioramento di Image Model 5, tuttavia, è l’editing di immagini a livelli.

In una demo, Adobe mi ha mostrato come funziona il nuovo modello Firefly. È possibile caricare un’immagine e Firefly Image Model 5 identificherà i diversi elementi, consentendo di spostarli, ridimensionarli e sostituirli con funzionalità generative. Nella mia demo, Adobe ha utilizzato una ciotola di ramen, mostrando come Image Model 5 sia stato in grado di ritagliare e spostare le bacchette in un’area diversa della scena. Oltre ad aggiungere una ciotola di fiocchi di peperoncino generati dall’intelligenza artificiale. Il tutto senza alcun artefatto visivo.

Firefly riceverà anche due nuove funzionalità di intelligenza artificiale generativa: Genera colonna sonora e Genera discorso. Entrambe fanno esattamente ciò che suggeriscono i loro nomi, con alcune specifiche limitazioni.

Genera colonna sonora e discorso, le novità di project relight su Firefly

Generate Soundtrack (genera colonna sonora) analizzerà un video caricato e suggerirà un suggerimento per una colonna sonora. Invece di eliminare il suggerimento e ricominciare da zero, Adobe ti consente di scegliere un’atmosfera, uno stile e uno scopo per trovare qualcosa di efficace. Ad esempio, potresti voler creare una colonna sonora orchestrale tesa da sovrapporre a una scena di inseguimento.

Con Generate Speech (genera discorso), Adobe ha per la prima volta aggiunto funzionalità di sintesi vocale a Firefly, sfruttando i propri modelli Firefly e quelli di ElevenLabs . Al momento del lancio, Adobe afferma che Generate Speech supporterà 15 lingue e sarà possibile aggiungere tag emozionali. Questi tag non sono universali, quindi è possibile aggiungere tag diversi a diverse parti di una riga per modificarne l’inflessione. Generate Soundtrack e Generate Speech saranno disponibili a breve su Firefly.

C’è anche un nuovo editor video Firefly. Per la prima volta, puoi accedere a un editor video completo e multitraccia nel tuo browser con Firefly integrato. Adobe afferma che è progettato per combinare più fonti, riunendo contenuti generati e acquisiti tramite video, audio e immagini. Ci sarà una lista d’attesa per l’editor video Firefly, ma Adobe non ha ancora annunciato quando verrà rilasciato su larga scala.

Photoshop ed Express avranno gli assistenti AI integrati

La parola d’ordine nel mondo dell’intelligenza artificiale è “intelligenza artificiale agentica”, un assistente che completa compiti specifici per te. Adobe offre già un assistente di questo tipo in Acrobat , ma sta portando la stessa funzionalità anche in Photoshop ed Express. Adobe afferma che l’assistente troverà un equilibrio tra “tattile e agentico”, fungendo in un certo senso da strumento didattico per navigare nelle app Adobe.

In Photoshop o Express, puoi richiamare l’assistente per svolgere diverse attività. Può indirizzarti verso lo strumento giusto a seconda di ciò che stai facendo, pur lasciandoti il controllo sul risultato finale. L’assistente AI in Express è ora disponibile per la prova , ma dovrai iscriverti alla lista d’attesa per Photoshop. Adobe afferma di stare valutando l’integrazione delle funzionalità Adobe direttamente in ChatGPT, utilizzando la stessa finestra per generare immagini, video e altro ancora utilizzando i modelli Adobe. Al momento, il progetto è ancora in fase iniziale, ma Adobe afferma di collaborare con OpenAI (tramite Microsoft) e l’obiettivo è integrare le sue funzionalità creative in ChatGPT.

Project Moonlight, invece, è un sistema progettato per trasferire il contesto dei modelli di intelligenza artificiale con cui interagisci nelle applicazioni creative di Adobe. Adobe afferma che potrai connettere i tuoi account social per fornire contesto al modello di intelligenza artificiale, generando contenuti che si adattano al tuo stile e tono. Potrai anche trasferire il contesto da altre applicazioni Adobe. Una beta privata di Project Moonlight verrà lanciata all’Adobe MAX per i partecipanti, e a breve è prevista una beta pubblica più ampia. Adobe non ha ancora annunciato una data di rilascio ufficiale.